Як стартапи вводять інвесторів в оману, приховуючи залежність від чужих моделей

Сфера штучного інтелекту виявилася менш інноваційною, ніж здається. Новий аналіз, опублікований на Medium, показав: 73% AI-стартапів не створюють власних моделей, а працюють на базі готових рішень — на кшталт ChatGPT, Claude або відкритих LLM із мінімальними змінами. Це ставить під сумнів гучні маркетингові обіцянки та вимагає більшої прозорості перед інвесторами та користувачами.

Більшість AI-стартапів не інноваційні — висновок аналітиків

За даними авторів дослідження на Medium, 73% молодих компаній у сфері штучного інтелекту базують свої продукти на сторонніх моделях і сервісах. Попри заяви про «власний ШІ», у більшості випадків це звичайні виклики API до популярних платформ.

Як працює «перепакований штучний інтелект»

Типовий сценарій виглядає так:

- доступ до API ChatGPT, Claude або open-source моделей;

- мінімальна адаптація (тюнінг промптів, просте навчання на наборі даних);

- застосунок або веб-сервіс із інтерфейсом, який подається як «власна AI-технологія».

Фактично розробка зводиться до обгортки навколо вже існуючої моделі.

Чому це проблема

Такий підхід створює виклики для ринку:

- ризик втрати довіри інвесторів — заявлені «запатентовані технології» можуть виявитися відсутніми;

- ослаблення конкуренції — компанії не створюють альтернативних моделей, а лише повторюють готові;

- нестійкість бізнесу — залежність від API означає, що сервіс може зупинитися через зміну умов постачальника.

Але не все однозначно

Аналітики наголошують: використання готових великих мовних моделей саме по собі не є негативним явищем. Проблема виникає тоді, коли стартапи:

- позиціонують сторонню модель як власну;

- отримують фінансування на «технологію», якої у них немає;

- вводять користувачів в оману щодо рівня інновацій.

Що це значить для AI-ринку

Експерти прогнозують, що наступний етап розвитку штучного інтелекту вимагатиме:

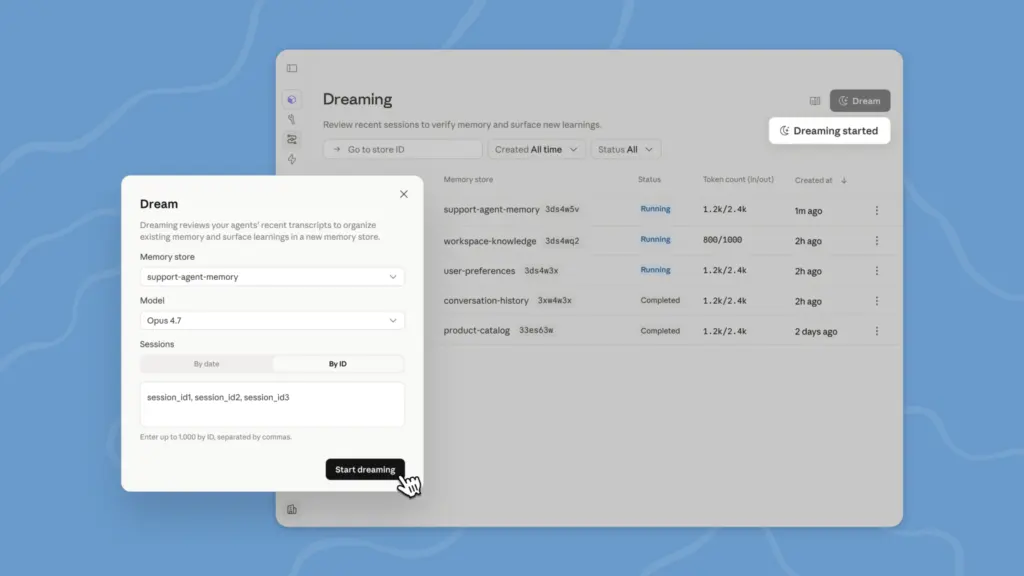

- прозорості походження моделей;

- відкритої інформації про використані API;

- чіткої різниці між «інтерфейсом над моделлю» та «власною AI-розробкою».